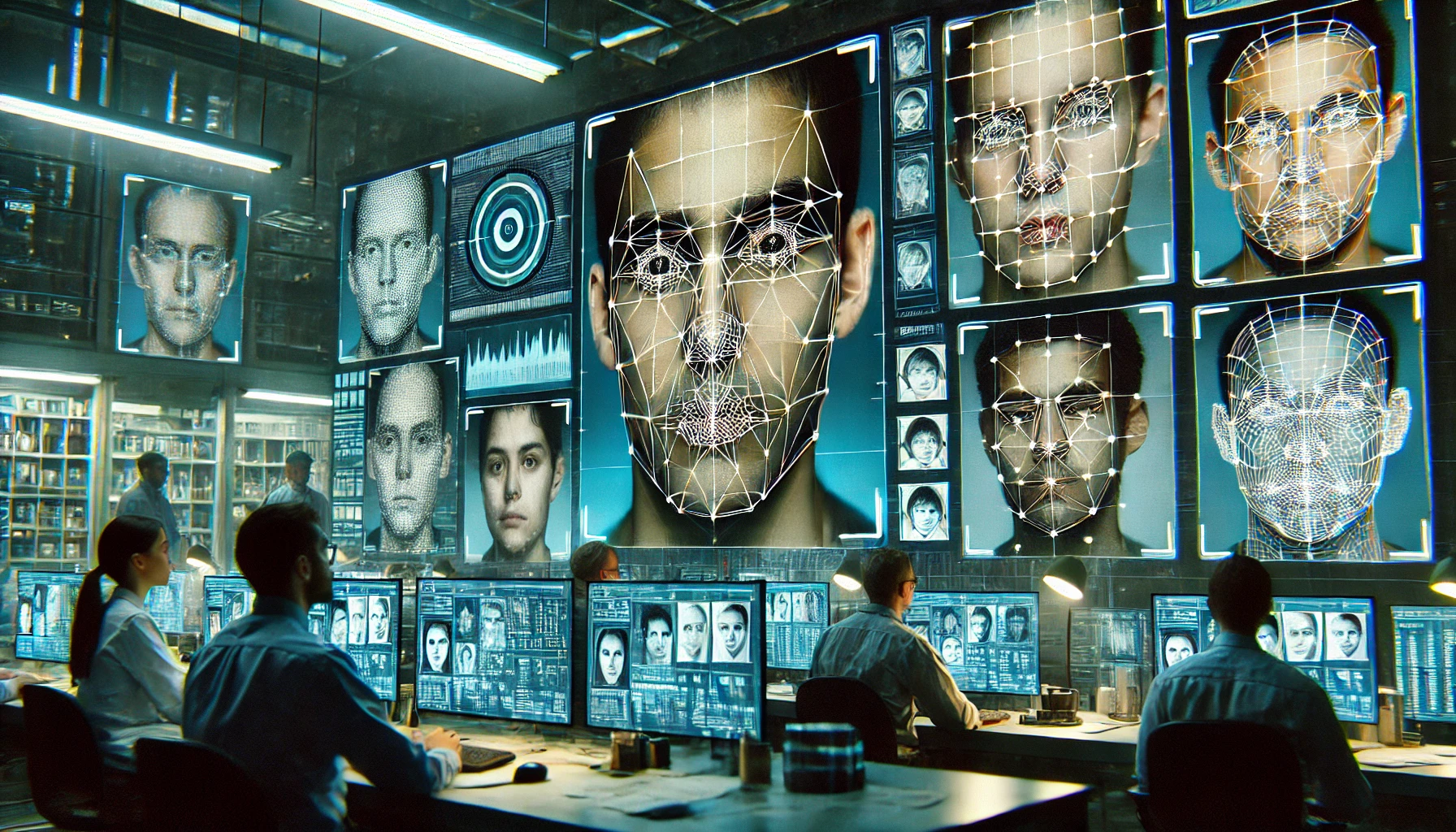

El reconocimiento facial es un software de seguridad biométrica que junto al reconocimiento de voz, huellas digitales, iris o retina configuran un aporte tecnológico de incalculable valor para las políticas de protección y seguridad en el vertiginoso siglo XXI. Su capacidad para identificar personas con precisión mediante el análisis de sus rasgos faciales serviría para mejorar la seguridad junto con otros aspectos como facilitar el acceso a dispositivos y simplificar la vida diaria. Y esto no ha hecho más que empezar; el desarrollo de reconocimiento facial 3D y el uso de biometría multimodal (combinación de diferentes formas biométricas, como huellas dactilares, voz y reconocimiento facial), también promete mejorar la precisión y la seguridad en su uso. Sin embargo, cuando esta tecnología comienza a aplicarse en áreas como la predicción de conductas criminales o la detección de mentiras, emergen preocupaciones éticas que nos llevan a recordar los peligros explorados en la literatura distópica. Las obras de autores como George Orwell, Philip K. Dick, Yevgueni Zamiatin y Aldous Huxley, entre otros, pueden darnos auténticas pinceladas sobre los riesgos de un control absoluto al ser humano mediante la vigilancia y el análisis predictivo.

La vigilancia total en «1984» de George Orwell

En la novela “1984”, Orwell describe una sociedad donde el «Gran Hermano» supervisa cada aspecto de la vida de los ciudadanos. La vigilancia es absoluta, llegando incluso al pensamiento de los individuos a través de la «policía del pensamiento». Este control no solo está dirigido a lo que las personas hacen, sino también a lo que podrían llegar a pensar. En este contexto, podemos trazar un paralelismo con la biometría facial moderna, que no se limita a registrar rostros, sino que se adentra en el análisis de las emociones y las intenciones de las personas. Las empresas de tecnología ya están trabajando en algoritmos que analizan microexpresiones faciales para prever comportamientos, lo que recuerda inquietantemente al concepto de Orwell de «vigilancia mental».

La idea de un futuro donde las autoridades pueden identificar pensamientos disidentes o predecir crímenes a través de expresiones faciales no está tan lejos de la realidad. Así como en “1984” los individuos son arrestados por pensar en rebelarse, la biometría facial podría llevar a que personas sean etiquetadas como peligrosas antes de que hayan cometido un crimen. Esto plantea un dilema ético profundo: ¿Qué significa la libertad en una sociedad donde el rostro de una persona puede ser interpretado como prueba de culpabilidad o intención criminal?

El precrimen en «Minority Report» de Philip K. Dick

En “Minority Report”, Philip K. Dick nos habla de un futuro donde el gobierno puede arrestar a los ciudadanos por crímenes que aún no han cometido, basándose en las visiones de «precognitivos». Este concepto de «precrimen» tiene una inquietante similitud con la biometría facial aplicada a la criminología predictiva. Aunque no contamos con “seres precognitivos”, las empresas están desarrollando tecnologías capaces de analizar patrones faciales y corporales para predecir conductas violentas o antisociales. El problema es que tales sistemas podrían no ser infalibles y estar sujetos a sesgos y errores.

En el mundo real, si la biometría facial se utiliza para predecir intenciones criminales, podría vulnerar derechos fundamentales como la presunción de inocencia. Además, ¿hasta qué punto es moralmente aceptable castigar o intervenir sobre alguien que aún no ha cometido un delito? Se puede estar ya planificando todo un conjunto de herramientas que me atrevería a denominar como “tecnología de la desconfianza”, donde el potencial de cometer un delito sea suficiente para justificar la vigilancia y el castigo.

La deshumanización en «Nosotros» de Yevgueni Zamiatin

“Nosotros” de Yevgueni Zamiatin es una de las primeras distopías modernas, y describe una sociedad donde los individuos son despojados de su individualidad. El estado trata a los ciudadanos como números, sin identidad propia. En la actualidad, la biometría facial podría llevar a una deshumanización similar al tratar a las personas como conjuntos de datos predecibles. Al reducir los rostros a patrones matemáticos, esta tecnología puede despojar a los individuos de su capacidad para expresar emociones auténticas sin ser monitoreados.

El rostro ha sido durante mucho tiempo considerado una ventana a las emociones humanas, una forma en que las personas pueden mostrar su vulnerabilidad o esconder sus sentimientos cuando lo desean. Si la biometría facial es capaz de leer hasta las expresiones más sutiles, nos enfrentamos al riesgo de una sociedad en la que no hay espacio para la privacidad emocional. En el mundo de Zamiatin, el control estatal erradica la espontaneidad y la autenticidad humana, algo que también podría suceder en un futuro dominado por la vigilancia facial.

El control de las emociones en «Un mundo feliz» de Aldous Huxley

Aldous Huxley, en “Un mundo feliz”, plantea un escenario donde las emociones son cuidadosamente controladas mediante condicionamientos y fármacos. Aunque su crítica se centra en el uso de la biotecnología para mantener a las personas dóciles y felices, podemos extrapolarla al control que la biometría facial podría ejercer sobre las emociones humanas. Si las empresas o los gobiernos son capaces de detectar la ansiedad, la tristeza o la ira a través de nuestras expresiones faciales, podrían implementar intervenciones psicofarmacológicas para regular nuestras emociones o castigar comportamientos considerados indeseables.

Esta intrusión en el espacio emocional podría eliminar la autenticidad humana. ¿Qué pasaría si siempre tuviéramos que controlar nuestras emociones por temor a ser detectados por un sistema biométrico? Huxley nos advierte de los peligros de eliminar el derecho a experimentar libremente nuestras emociones.

Otras distopías relevantes

En “The Circle” de Dave Eggers, se explora la invasión de la privacidad a través de la vigilancia digital. Las empresas utilizan tecnologías de monitoreo para acumular poder, un escenario que puede verse replicado en el uso de la biometría facial por corporaciones privadas. Los sistemas de monitoreo facial podrían ser utilizados para evaluar comportamientos en tiempo real, controlando tanto la vida laboral como personal de los individuos.

Un ejemplo más cercano a nuestro momento actual es la serie “Black Mirror”, que en su episodio «Nosedive» muestra un futuro en el que las personas son constantemente evaluadas a través de sus interacciones sociales y su comportamiento. Aquí, la biometría facial podría desempeñar un papel crucial en un sistema de reputación que defina el valor de las personas en función de su conformidad con las normas sociales, un camino peligroso hacia la homogenización social.

Como conclusión, la biometría facial, cuando se utiliza para detectar comportamientos criminales o mentirosos, plantea preguntas éticas profundas. Al igual que en las distopías literarias, corremos el riesgo de caer en una sociedad donde la vigilancia constante elimine la privacidad, la autenticidad emocional y la libertad de pensamiento. Si no reflexionamos ahora sobre los límites éticos de esta tecnología, podríamos enfrentarnos a un futuro donde nuestros rostros ya no nos pertenecen, sino que son herramientas del control estatal o corporativo.

Las distopías nos siguen ofreciendo lecciones magistrales sobre los peligros de un control total mediante la tecnología, y debemos escuchar esas advertencias antes de que la biometría facial se convierta en una realidad distópica.