La Inteligencia Artificial Generativa (IAG) constituye una vertiente de la inteligencia artificial centrada en la creación de contenido nuevo u original a partir de información ya existente. Esta tecnología se vale de algoritmos y redes neuronales avanzadas para asimilar datos en forma de textos e imágenes, y posteriormente generar material original y distintivo. En los últimos años, se han observado notables avances en el campo de la IAG y se anticipa que seguirá evolucionando positivamente en el futuro.

La IAG procesa gran cantidad de contenido y ofrece información valiosa y respuestas mediante texto, imágenes y formatos fáciles de usar. La inteligencia artificial generativa se puede usar para:

– Optimizar las interacciones con los clientes mediante chats mejorados y experiencias de búsqueda.

– Acceder a grandes cantidades de datos sin estructurar a través de interfaces de conversación y resúmenes.

– Facilitar tareas repetitivas como responder a solicitudes de propuestas, localizar contenido de marketing en diversos idiomas y comprobar el cumplimiento de los contratos con los clientes. Un elevado número de empresas está restringiendo la utilización de aplicaciones de inteligencia artificial generativa (IAG) debido a las preocupaciones sobre privacidad y seguridad de datos. Según un reciente estudio de Cisco, el 31% de las organizaciones en España ha limitado completamente el uso de aplicaciones de IAG en la actualidad, en comparación con el 27% a nivel mundial.

Estas organizaciones perciben la inteligencia artificial generativa como una tecnología notablemente distinta que presenta nuevos desafíos. Entre las principales inquietudes se destacan las amenazas a los derechos legales y de propiedad intelectual de la empresa (73% en España) y el riesgo de revelar información al público o a competidores (71%).

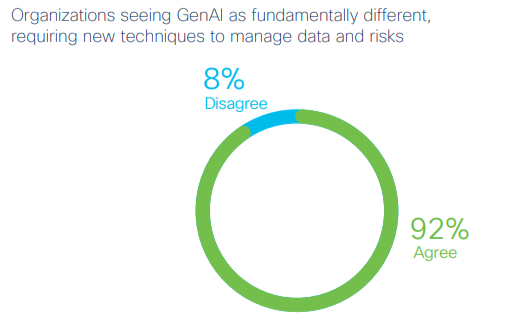

Por ello, el 92% de las organizaciones españolas considera que la IA requiere nuevas estrategias para gestionar los datos y riesgos, y la mayoría está aplicando controles para reducir su exposición. El 62% ha establecido restricciones sobre los datos que pueden ser utilizados, el 57% supervisa las herramientas de IAG que pueden utilizar los empleados y el 31% ha prohibido temporalmente cualquier aplicación de IA generativa.

Sin embargo, a pesar de estas precauciones, muchas empresas en España han incorporado datos sensibles en aplicaciones de IA, como información de empleados (43%) o datos no públicos sobre la empresa (47%).

La transparencia en el uso de la IA progresa lentamente, ya que el 90% de las organizaciones españolas reconocen la necesidad de hacer más para asegurar a sus clientes que sus datos se utilizan exclusivamente con fines previstos y legítimos. Los clientes consideran esencial obtener información clara y precisa sobre cómo se utilizan sus datos, evitando su venta con fines comerciales. Por otro lado, las empresas españolas destacan la importancia de cumplir con las leyes de privacidad y prevenir violaciones de datos.

La inteligencia artificial generativa, como la representada por modelos como GPT-3, puede plantear diversos problemas relacionados con la propiedad intelectual. Algunos de los desafíos y cuestiones asociadas incluyen:

- Generación automática de contenido protegido por derechos de autor: La IA generativa puede producir contenido que infringe derechos de autor, ya que puede crear textos, imágenes, música u otros tipos de obras que se asemejan a material protegido sin intención directa de hacerlo.

- Ambigüedad en la autoría: Determinar la autoría de un contenido generado por IA puede ser complicado. Puede ser difícil atribuir la creación a un humano específico, lo que complica la aplicación de derechos de autor y la responsabilidad legal.

- Uso no autorizado de datos de entrenamiento: Si la IA se entrena con conjuntos de datos que contienen material protegido por derechos de autor sin la debida autorización, puede haber problemas legales relacionados con el uso no autorizado de esos datos.

- Plagio inadvertido: La IA generativa puede producir contenido que se asemeje demasiado a trabajos existentes, lo que podría llevar a casos de plagio inadvertido y disputas sobre la originalidad de la obra.

- Responsabilidad legal: En situaciones donde la IA genera contenido perjudicial o ilícito, puede ser desafiante determinar quién es responsable legalmente. ¿Es el desarrollador del modelo, el usuario final o la IA misma?

- Creación de obras derivadas: La generación automática de obras derivadas puede plantear preguntas sobre los derechos de autor, especialmente si la IA utiliza material protegido como base para crear nuevas obras.

- Protección de algoritmos: Los modelos de inteligencia artificial en sí mismos pueden considerarse como propiedad intelectual, y puede haber disputas sobre la protección de los algoritmos subyacentes, los cuales son fundamentales para el funcionamiento de la IA generativa.

- Impacto en el mercado de la creatividad humana: La generación masiva de contenido por parte de IA podría afectar el mercado de la creatividad humana, planteando preguntas éticas y económicas sobre la competencia entre la creación humana y la generada por máquinas.

Es importante destacar que la legislación y las normativas relacionadas con la propiedad intelectual pueden variar según la jurisdicción y estos problemas están en constante evolución a medida que la tecnología avanza. Por lo tanto, la resolución de estos problemas puede requerir cambios en las leyes y políticas existentes.